“Me venden en contra de mi voluntad. No consentí que me sexualizaran”. La frase no es de una víctima de trata ni de “pornovenganza”, ni un hackeo de fotos íntimas. Su autora es Sweet Anita, una joven streamer inglesa con 1,9 millón de seguidores en Twitch. Y lo que denuncia es la práctica que la ha elevado a una nueva categoría de víctima: la de quienes mediante la Inteligencia Artificial (IA) generativa se ven “protagonizando” contenido porno sin su consentimiento. Los casos se multiplican en todo el mundo, reseña la publicación de tecnología Xataka.

El de Anita no es un caso único, al contrario. Ni es un problema solo de famosas, como Anita. Viene de unos cuantos años atrás y algunas celebrities, como Scarlet Johansson, Emma Watson o Gal Gadot llevan tiempo lidiando con él. Tanto, que Johansson ha llegado a dar por “causa perdida” el “tratar de protegerse de la depravación de Internet”. A medida que la IA ha evolucionado, ofreciendo herramientas más sofisticadas, accesibles y capaces de generar piezas más realistas, la producción de imágenes falsas o “deepfakes” dejó de ser una amenaza exclusiva de cantantes y estrellas de Hollywood.

Llegó a las “streamers”, como Sweet Anita o QTCinderella, conocida por sus contenidos sobre videojuegos y repostería, que acabó “protagonizando” un video sexual generado con ayuda de la inteligencia artificial. “Verte desnuda en contra de tu voluntad y difundida por la Red es como sentirse violada”, confesó, sumándose así a la denuncia de otras celebridades del streaming. En Reino Unido hubo una fuerte polémica después de que otro streamer reconociese haber pagado por contenido en una página que mostraba videos de varias compañeras.

Mientras Scarlett Johansson da por perdida la lucha, juristas dicen que no hay un vacío legal Mientras Scarlett Johansson da por perdida la lucha, juristas dicen que no hay un vacío legal

La tecnología lo hace cada vez más sencillo y accesible. He ahí la clave, como apuntan desde la cadena NBC News, que ha realizado un estudio para comprobar lo fácil que resulta acceder a “deepfakes”. Esta accesibilidad es tanto para videos porno, a los que se puede acceder de forma más o menos sencilla con una simple búsqueda en Google, como a los propios autores de las piezas, que recurren a la plataforma Discord para anunciar la venta del material. O servicios para creaciones personalizadas.

En España

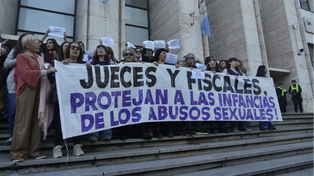

El abuso llegó incluso al interior profundo de España. El portal de la televisión estatal española informa de un caso que involucra a menores. Un grupo de menores han sido esta semana identificados e interrogados por la difusión de imágenes creadas con inteligencia artificial (IA) para simular el desnudo de otras jóvenes, también menores. El hecho ocurrió en la ciudad de Almendralejo, Badajoz. El caso ha destapado dudas. “¿Nuestra legislación lo contempla como delito?, ¿y si las víctimas fueran mayores de edad? Y sobre todo, ¿no se podría haber evitado?”, se interroga RTVE.

“Lleva pasando desde por lo menos 2017, cuando a alguien se le ocurrió tomar la cara de (la actriz]) Gal Gadot en Wonder Woman y plantarla encima de un video de pornografía californiana. Ya han pasado varios años y estamos viendo que la victimización de niñas es una realidad”, denunció la experta en tecnología Marta Peirano. Destaca que el problema tiene un claro sesgo de género. Según el informe de 2019 de una empresa de monitorización de “deepfakes”, el 96% de las imágenes de creadas por la IA son pornografía no consentida y prácticamente en su totalidad afecta a mujeres. Expertos en ética y juristas recuerdan que no podemos juzgar la tecnología en sí _por ejemplo, un cuchillo_, sino su uso _cortar jamón o matar a una persona_, y remiten a la legislación vigente para condenar hechos delictivos contra la intimidad, la propia imagen, la integridad moral o el honor.

"No hay vacío legal"

“Ni hay un vacío legal como dicen algunos, ni está todo hecho. Para eso se van actualizando las leyes y mejorando el marco regulatorio”, señala Borja Adsuara Varela, doctor en Filosofía del Derecho y consultor experto en derecho digital, privacidad y protección de datos: “Si yo cometo una estafa, da lo mismo si es por métodos electrónicos o no, sigue siendo una estafa”.

El caso de Almendralejo está atravesado por un factor: tanto las víctimas como los agresores son menores de edad. Así, aunque las penas vayan a ser más laxas y centradas en la reeducación, según el catedrático de Derecho Penal, Josep Maria Tamarit, los hechos pueden encajar en un delito de pornografía infantil, para lo que el juez de menores deberá valorar el contexto y el contenido sexual de las imágenes. En ese sentido, Borja Adsuara subraya que las reformas del Código Penal español ya incluyen la pornografía infantil virtual. La necesidad surgió en los 90, mucho antes de la IA. “Para bien o para mal, la IA ha democratizado cosas que antes solo podían hacer quienes tuvieran conocimientos técnicos de Photoshop, pero el delito en sí es el mismo”, afirma.